生成AIが日常のインフラとして浸透する中で、「性愛」や「親密性」との接続は、最も慎重に扱われている領域のひとつだ。その象徴的な事例が、OpenAIによるChatGPTの成人向け“性的表現”機能、いわゆる「アダルトモード(Adult Mode)」の開発遅延である。

報道ベースでは、この機能はすでに一定の設計が進んでいるとされる。しかし、当初は2025年末には提供開始とされていた同機能は、2026年3月時点においても正式な提供には至っていない。この遅れは単なる開発上の問題だけではなく、「親密性を扱うAI」という新しい領域に特有の構造的な困難を示していると考えられる。

ChatGPTが扱おうとしているのは「ポルノ」ではなく「関係性」である

まず前提として、ChatGPTにおける成人向け機能は、従来のポルノ生成とは明確に異なる方向で検討されている。報道によれば、画像や動画ではなく、あくまでテキストベースのエロティカ、すなわち“性的表現”の範囲に限定される設計が想定されている。

この点は、既存の記事でも整理されている通り、単なるコンテンツ解禁ではなく、「どこまでを表現として許容するか」というグラデーション設計の問題として扱われている。

しかし、より重要なのは、この機能が単発の生成ではなく、会話としての連続性を前提としている点にある。ChatGPTはユーザーとのやり取りを通じて文脈を保持し、場合によっては記憶機能によって関係性を蓄積する。この構造の中で性的なやり取りが行われる場合、それは単なる“表現”ではなく、“関係”そのものになる。

つまり、問題は「エロを生成するかどうか」ではなく、「親密性をどのように扱うか」という設計へと移行している。

なぜ開発は遅れているのか

同機能の開発が遅れている理由は、まずもって「優先順位の問題」が挙げられるだろう。現在のAI開発競争は、OpenAI、Google DeepMind、Anthropicといった主要AIラボ間で、モデル性能はもとより、推論能力やエージェント機能、マルチモーダル統合といった領域を中心に激化している。とりわけ、ビジネス用途や開発者エコシステムに直結する領域、すなわち「仕事で使えるAI」「自律的にタスクを遂行するAI」の進化が、収益と市場シェアの観点で最優先されているのが現実だ。

この文脈において、成人向け機能は戦略的に後順位に置かれやすい。理由は明確で、短期的な収益インパクトが限定的である一方、規制リスクやブランド毀損リスクが極めて高いからである。企業向け導入や教育分野への展開を進める中で、性的機能の実装はプロダクト全体の信頼性に影響を与えかねない。結果として、「安全で汎用的な知能インフラ」としての地位確立を優先し、その後に、より周縁的かつリスクの高い領域へ拡張するという順序を取らざるを得ないことが推察される。

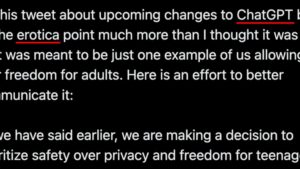

また、技術的な理由もありそうだ。とりわけ大きいのが、年齢確認(Age Verification)技術の精度と、その限界に起因するリスクである。OpenAIは、ユーザーの利用パターンや行動シグナルをもとに年齢を推定する仕組みを導入しているが、これは一定の誤認を前提とせざるを得ない。実際、The Vergeの報道によると、年齢予測システムが未成年を成人と誤分類するケースが約12%あると報じている。

仮に成人向け機能を開放した場合、その誤差がそのまま未成年へのアクセス許容として顕在化する可能性がある。そして問題は、それが単なる「閲覧リスク」にとどまらない点にある。

「親密性データ」という、これまでにないリスク

ChatGPTの成人向け機能が抱える最大のリスクは、そこに蓄積されるデータの性質にある。

ユーザーがAIと性的な対話を行う場合、そこには単なる表層的な会話情報以上の情報が含まれる。つまり、会話に包含される性的嗜好や感情の状態、関係性の履歴、さらには欲望や不安といった内面的な情報が、会話の中で自然に表出する。

この点について、WIREDは「親密な監視(intimate surveillance)」という概念を提示している。

従来のデータリスクは、検索履歴や購買履歴といった行動データが中心だった。しかし、親密データはそれとは質的に異なる。これは単なる行動の記録ではなく、人格や関係性そのものに関わる情報である。この種のデータは、一度流出すれば取り返しがつかないだけでなく、本人のアイデンティティと深く結びついている。また、個人単体ではなく、他者との関係性を含む点でも従来の個人情報とは異なる構造を持つ。

Wall Street Journalもまた、この機能に関して、安全性やモデレーション、ユーザーとの関係性深化の問題を指摘しており、ここで問われているのは、「どこまで表現を許すか」ではなく、「どこまで関係性を記録してよいのか」という問題となっている。

領域限定のアダルトプロダクトとの決定的な違い

この問題をより明確にするためには、従来のアダルトプロダクトとの違いを理解する必要がある。

従来のアダルトプロダクトは、特定の用途に閉じたサービスとして設計されていた。ユーザーは明確な目的を持ってアクセスし、その範囲内で体験が完結する。そこでは、機能とリスクの境界も比較的明確だった。

一方でChatGPTは、日常会話と親密性が“連続”している。仕事の相談から恋愛の話題に移り、そこからさらに性的な内容へと対話が移行することもあり得るだろう。この文脈の連続性こそが、OpenAIのような日常的な活用を踏まえた対話型AIの特徴であり、同時にリスクでもある。

つまり、ChatGPTは「性を扱うサービス」ではなく、「関係性を記録するインフラ」になりつつある。この構造の違いが、問題の難易度を一段引き上げていると言える。

実際、過去を振り返るとChatGPTのユーザー情報が流出したり、意図せず公開されたりしたことがある。例えば2023年3月20日には、同社のオープンソースライブラリの不具合によって他人のチャット履歴のタイトルが見えてしまう問題が発生し、OpenAIは一時的にサービスを停止している。また、2025年にはチャットの共有設定の仕組みを理解していなかったユーザーによって、多くの対話がGoogle検索のインデックスに登録され、誰でも閲覧できる状態になっていた。

もちろん、後者はプロダクトの不具合ではなくオペレーションの問題ではあるものの、ユーザーオペレーションによっては問題が起きる可能性があることを前提とするには、「親密性データ」はあまりにもセンシティブである。

以下のブロックを、記事の最後(結論セクション直前 or 直後)に追加する形で使えます。トーンと文脈を既存本文に合わせています。

OpenAI自身も3/17の安全性に関する発表で「未成年保護」を最優先課題として明示

こうした状況を踏まえると、OpenAI自身がどのようにこの問題を認識しているかは重要な示唆を与える。実際、同社は2026年3月17日に「未成年の安全に関するブループリント」を公表。今後の設計方針を明確にしている。

この中でOpenAIは、対話型AIにおける未成年保護を最優先課題の一つとして位置付け、年齢推定技術の高度化、ペアレンタルコントロールの強化、安全なデフォルト設定、そしてリスクの高い領域におけるアクセス制御の厳格化などを包括的に進める方針を示している。

特に注目すべきは、「年齢に応じた体験設計(age-appropriate design)」という考え方が明確に打ち出されている点だ。これは単に未成年を排除するのではなく、年齢に応じて提供する機能や体験そのものを変えるという発想である。

この方針を、件のChatGPTのアダルトモードと重ねて見ると、その遅延の意味はより明確になる。すなわち、成人向け機能の実装は単体で成立するものではなく、年齢推定、アクセス制御、コンテンツ制限、データ管理といった複数の安全機構が一定水準に達して初めて可能になるという構造である。特に本記事で見てきたように、「親密性データ」が扱われる領域においては、未成年保護は単なるコンプライアンスではなく、プロダクトの前提条件そのものになる。

「親密性をどのように扱うか」という設計が未確立であることが問題

以上を踏まえると、ChatGPTの成人向け機能が遅れている理由には様々な要因がありつつも、「親密性をどのように扱うか」という設計が未確立であることが大きなポイントと言えそうだ。

技術的には実現可能であっても、年齢確認、モデレーション、心理的影響、そしてデータ管理という複数の課題が同時に解決されなければ、公開には踏み切れない。この問題は単一の企業で解決できるものではなく、規制や社会的合意とも深く関係する話だろう。もちろん、この課題はChatGPTに限らない。今後、あらゆる対話型コミュニケーションプロダクトが同様の問題に直面することになるだろう。

親密性は、人間にとって最も重要な領域のひとつである。その領域をテクノロジーが扱う以上、「どこまで踏み込むのか」「どのように守るのか」という問いは避けて通れない。

文・長岡武司