LoveTech Media編集部コメント

人との「ちょうどいい距離感」を察するロボット。

そんな存在の誕生が近いかもしれない。

この度、芝浦工業大学 工学部情報工学科の菅谷みどり教授が、脳波や心拍といった生体信号の簡易計測値によって、人の感情を推定する手法を考案した。

菅谷教授は「人の心によりそうロボットの研究開発」に取り組んでおり、高齢化等社会背景に鑑みた人とロボットの共生社会を迎える中で、人とロボットとの「心地よい距離」を考慮するなど、感情に応じた制御によって人に好印象を与えるロボットを誕生させるべく、研究を進めている。

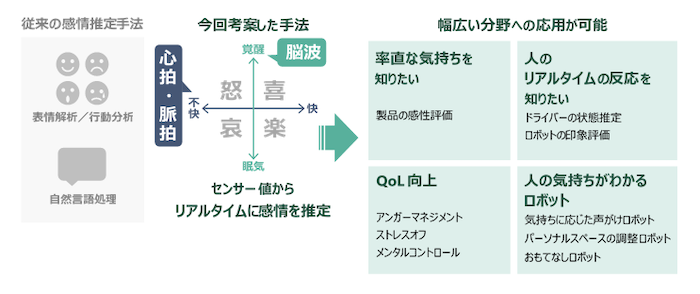

今回の研究、具体的には、覚醒・眠気と快・不快の2軸上に感情分類を行う心理学モデルをもとに、脳波や心拍(自律神経計測)などの計測可能な生体信号のセンサー値を対応させ、感情のもとになる短期的な状態変化である“情動”を、リアルタイムに推定する方法だという。

これまで、ロボットによる感情分析研究で取られていた手法の多くは、表情からの感情推定であった。

皆様も、AI関連の展示会で一度はご覧になったことがあるだろう。

ただ、そもそも表情というものには個体差があり、それ故に推定の精度も低いものとなっていた。

また、脳波を活用した研究も存在するが、今度は脳の活動状態が可視化されるものの、喜怒哀楽の推定難易度が依然として高い状況であった。

今回発表された取り組みは、脳波や心拍といった生体信号のセンサー値をリアルタイムで分析・推定し、それに応じた適切なフレーズを選択し声がけを行うというもの。

つまり、その瞬間瞬間で変化する人の感情を生体信号を通じてリアルタイムで推定していくという、国内でも初めての試みとなる。

また、ロボットが速度や移動方法を変えた時にどのように印象が変化するかについて、人とロボットのパーソナルスペース評価することで、ロボットが人の気持ちを察することができるようになるという。

これらの研究成果の応用範囲は広く、製品への感性評価や印象に関わるテストといった「人の率直な気持ちを知りたい」ニーズから、ドライバーの状態推定やアンガーマネジメントといった「人のリアルタイムな反応を知りたい」ニーズ、そのほかメンタルコントロールやストレスオフなど、様々な展開が期待される。

センサー技術が発達し、人々の生体情報がリアルタイムで収集・分析しやすくなることに併せて、ロボットの感情推定レベルも上がっていく。

どうやら想定よりもずっと早く、ロボットとのコミュニケーションは、“愛想の良い人間”レベルのおもてなしがスタンダードになるかもしれない。

詳しい研究内容については、以下、今年6月13日に開催された「芝浦工業大学 新技術説明会」での菅谷みどり教授による発表も併せてご覧いただきたい。

以下、リリース内容となります。